「データ統合基盤をどのように構築すればよいかわからない」「複数のシステムに散在するデータを一元化したいが、どこから手をつければよいか」——こうした課題を抱えるIT担当者やデータエンジニアは少なくありません。ERP、CRM、SaaS、IoTデバイスなど、現代の企業環境では多種多様なデータソースが存在し、それらを統合する基盤の構築はビジネスのデータ活用を左右する重要なプロジェクトです。適切なフェーズと方法論に従って進めることが、プロジェクト成功の最大の鍵となります。

本記事では、データ統合基盤構築の全体像から具体的な進め方、費用相場、成功のポイントまでを体系的に解説します。現状分析・要件定義から、アーキテクチャ設計・ツール選定、構築・データ連携・テストに至るまでの各フェーズで押さえるべき作業内容と注意点を詳しく説明します。はじめてデータ統合プロジェクトに取り組む方から、過去に失敗を経験した方まで、幅広くお役立ていただける内容です。

本テーマに関する全体ガイドは、以下の記事をご覧ください。

▼全体ガイドの記事

・データ統合基盤構築の完全ガイド

データ統合基盤構築の全体像

データ統合基盤とは、企業内外に散在するさまざまなデータソースを一元的に収集・変換・蓄積・活用するためのシステム基盤を指します。ETL/ELTパイプライン、データウェアハウス、データマート、データカタログといった複数のコンポーネントを統合し、ビジネスインテリジェンスやAI・機械学習の基盤として機能します。構築の全体像を把握したうえで、各フェーズの目的と成果物を明確にしながら進めることが重要です。

データ統合基盤とは何か・特徴

データ統合基盤とは、ERP(基幹業務システム)、CRM(顧客管理システム)、SaaS各種サービス、IoTデバイス、Webログなど、企業内外に分散する多様なデータソースから情報を収集し、一元的に管理・活用できる状態に整える技術基盤の総称です。具体的には、データ収集のためのETL(Extract・Transform・Load)またはELTパイプライン、長期保存・分析クエリのためのデータウェアハウス(Snowflake、BigQuery、Amazon Redshiftなど)、部門別に最適化されたデータマート、そしてデータの所在や品質を管理するデータカタログが統合的に構成されます。これらが有機的に連携することで、企業全体のデータを一貫したルールのもとで活用できる環境が実現します。

データ統合基盤の大きな特徴は、単なるデータ収集に留まらず、データの品質・ガバナンス・セキュリティまでを包括的に管理する点にあります。データリネージュ(データがどこから来てどのように変換されたかの追跡)の可視化、マスターデータ管理(MDM)による顧客・商品などのマスター情報の統一、アクセス権限管理によるセキュリティの確保など、データを「信頼できる資産」として扱うための仕組みが組み込まれています。また、バッチ処理によるデータ連携だけでなく、リアルタイムストリーミング処理(Apache Kafka等)との組み合わせにより、即時性の高いデータ活用も可能となっています。

データ統合基盤が必要とされる背景

デジタルトランスフォーメーション(DX)の進展により、企業が扱うデータの量・種類・発生速度は急激に増大しています。かつては基幹システム(ERP)が中心だったデータの発生源が、今日ではCRM、MA(マーケティングオートメーション)、ECサイト、IoTセンサー、SNS、コールセンターシステムなど多岐にわたります。それぞれのシステムが独自のデータ形式とストレージを持つため、「データサイロ」と呼ばれる情報の孤立化が進み、経営判断や業務効率化に必要なデータを横断的に活用することが困難になっています。

また、AI・機械学習の活用が本格化する中で、モデルの精度を高めるためには大量の高品質な学習データが不可欠となっています。データが各システムに分散したままでは、AIプロジェクトの立ち上げにデータ収集・整備だけで膨大な時間とコストがかかり、ビジネス価値の実現が遅れます。データ統合基盤を整備することで、データを必要なときに必要な形で提供できる「データの民主化」が実現し、データドリブン経営の土台が構築されます。さらに、2024年以降のデータプライバシー規制の強化(個人情報保護法改正、GDPR等)への対応という観点からも、データの所在と流れを一元管理できる統合基盤の重要性は高まり続けています。

データ統合基盤構築の進め方

データ統合基盤構築は、現状分析・要件定義、アーキテクチャ設計・ツール選定、構築・データ連携・テストという3つの大きなフェーズで進みます。各フェーズでの成果物と承認プロセスを明確にしながら段階的に進めることで、手戻りを最小化し、品質の高いデータ統合基盤を効率的に構築することができます。以下では、各フェーズで行うべき作業内容と押さえるべきポイントを詳しく説明します。

現状分析・要件定義フェーズ

最初のフェーズでは、現在の企業内データの全体像を把握することから始めます。どのシステムにどのようなデータが存在するか(データソースインベントリの作成)、データの発生頻度・量・形式(構造化・非構造化・半構造化)、各システム間のデータ連携の現状(既存のETLバッチや手作業でのCSV連携など)を網羅的に調査します。この現状把握なしには、適切な統合基盤の設計が不可能であり、後工程での大きな手戻りの原因となります。業務部門へのヒアリングとIT部門へのシステム調査を並行して進め、データマップ(どのシステムにどんなデータがあるかの全体図)を作成することが重要です。

要件定義では、ビジネス側のニーズとIT側の技術要件を両面から整理します。ビジネス要件としては、「どの部門がどのようなデータ分析を行いたいか」「どの経営指標(KPI)をリアルタイムで把握したいか」「データ活用によってどのような業務改善を実現したいか」を明確にします。技術要件としては、対象データソース数とデータ量、更新頻度(バッチ/リアルタイム)、データ保持期間、セキュリティ・コンプライアンス要件、既存システムとの接続方式、性能・可用性要件(SLA)を定義します。これらの要件定義書を関係者全員でレビュー・承認したうえで次フェーズに進むことが成功の必須条件です。

アーキテクチャ設計・ツール選定フェーズ

要件定義が完了したら、データ統合基盤全体のアーキテクチャ設計とツール選定を行います。アーキテクチャ設計では、データレイク・データウェアハウス・データマートの構成、ETL/ELTパイプラインの設計、データカタログとメタデータ管理の仕組み、セキュリティ・アクセス制御の設計を行います。クラウドネイティブな構成(AWS、GCP、Azure)かオンプレミスとのハイブリッド構成か、またはマルチクラウド構成かを決定することも、このフェーズの重要な意思決定事項です。

ツール選定では、データオーケストレーション(Apache Airflow、Prefect)、ETL/ELTツール(Talend、Informatica、AWS Glue、Azure Data Factory)、データウェアハウス(Snowflake、BigQuery、Amazon Redshift)、データカタログ(Apache Atlas、Alation、DataHub)の各レイヤーで最適なツールを選択します。選定にあたっては、既存システムとの接続性、チームのスキルセット、ライセンスコスト、ベンダーサポートの品質を総合的に評価することが重要です。特にETLツールは、接続できるデータソースコネクタの豊富さと変換処理の柔軟性が、その後の運用効率に大きく影響します。また、将来的なデータ量増加や新規データソースの追加に対応できる拡張性も重視すべきポイントです。

構築・データ連携・テストフェーズ

構築フェーズでは、設計書に基づいてインフラ環境の構築(クラウドリソースのプロビジョニング、ネットワーク設定、セキュリティグループ等)を行い、データウェアハウスのスキーマ設計・作成、ETL/ELTパイプラインの実装を進めます。アジャイルな開発アプローチを採用し、まず優先度の高いデータソースを対象にパイプラインを実装・検証し、段階的に対象を拡大していく進め方が効果的です。各パイプラインの実装後には、データ品質チェック(ソースと連携先のレコード件数・合計値の照合、NULL値チェック、重複チェックなど)を必ず実施します。

テストフェーズでは、単体テスト(個別パイプラインの動作確認)、統合テスト(複数のパイプラインを組み合わせたエンドツーエンドの検証)、性能テスト(大量データ処理時の処理時間・リソース使用量の確認)、データ品質テスト(ビジネスルールに基づくデータ整合性の検証)を順次実施します。特に本番移行前の初期データロード(ヒストリカルデータの移行)は、データ量が大きい場合に時間がかかるため、移行計画と切り戻し手順を事前に詳細に準備しておくことが重要です。本番稼働後も、パイプラインの実行状況・エラー・処理時間を監視するモニタリング基盤を整備し、安定運用を維持するための体制を構築します。

データ統合基盤構築の費用相場

データ統合基盤構築の費用は、対象となるデータソースの数、データ量、要求される処理速度(バッチ/リアルタイム)、利用するツール・クラウドサービス、そして開発チームの構成によって大きく異なります。概算として、小規模から大規模まで幅広い価格帯が存在しますが、投資対効果(ROI)の観点から適切な規模感で計画することが重要です。

規模別の費用目安

小規模なデータ統合基盤(データソース5個以下、主にクラウドSaaSとの連携、バッチ処理中心)の場合、構築費用の目安は200万〜800万円程度です。この規模では、AWS GlueやAzure Data Factoryなどのマネージドサービスを活用し、Snowflakeの小規模プランと組み合わせることで比較的低コストに実現できます。エンジニアの人月単価80万〜150万円に基づくと、3〜6ヶ月のプロジェクト期間で2〜3名のチームで対応できる規模感です。

中規模(データソース5〜20個、複数のオンプレミスシステムとクラウドの連携、一部リアルタイム処理を含む)では、800万〜3,000万円程度が目安となります。大規模(データソース20個以上、グループ企業全体のデータ統合、リアルタイムストリーミング処理を含む複雑な構成)では、3,000万〜2億円以上のプロジェクトになることも珍しくありません。大規模案件ではInformaticaのエンタープライズライセンス(年間数百万〜数千万円)の採用や、専任のデータアーキテクトを含む大規模な開発チームの編成が必要となるため、コストが大きく増加します。

コスト内訳と注意点

データ統合基盤構築のコストは大きく、①ツール・ライセンス費用、②インフラ・クラウド費用、③開発・コンサルティング費用の3つに分類されます。ツール費用では、TalendやPentahoのオープンソース版を活用することで初期コストを抑えられる一方、エンタープライズ版では年間数百万円のライセンス費用が発生します。AWS Glueは$0.44/DPU-hourで利用できますが、処理データ量が増えるとクラウド費用も相応に増加するため、コスト試算を事前に詳細に行うことが重要です。

開発費用は全体コストの50〜70%を占めることが多く、要件定義・設計フェーズと、本番稼働後の運用保守コストを見落とさないことが重要です。特にデータ統合基盤は一度構築して終わりではなく、新規データソースの追加、ビジネス要件の変化に伴うパイプラインの改修、ツールのバージョンアップ対応など、継続的なメンテナンスコストが発生します。年間の運用保守費用として、初期構築費用の15〜25%程度を見込んでおくことが現実的です。また、初期ロード(過去データの移行)は予想以上に時間とコストがかかるケースが多いため、事前に十分な工数を確保しておくことが重要です。

データ統合基盤構築を成功させるポイント

データ統合基盤構築プロジェクトの成功率を高めるためには、技術的な設計の質だけでなく、プロジェクトマネジメントとステークホルダーとの合意形成が非常に重要です。以下では、設計フェーズでの重要ポイント、データガバナンスとセキュリティ、そしてパートナー選定のポイントについて解説します。

設計フェーズでの重要ポイント

設計フェーズで最も重要なのは、「将来の拡張性を織り込んだアーキテクチャ」を設計することです。現時点での要件だけを満たすシステムを構築すると、1〜2年後に新規データソースの追加やデータ量の増大に対応できず、再構築を余儀なくされるケースが多くあります。スケーラブルなクラウドネイティブアーキテクチャを採用し、データレイヤーごとに疎結合な設計にすることで、将来の変更コストを最小化できます。また、データモデリングにはインモン方式(エンタープライズDWH)またはキンボール方式(データマート指向)の設計手法を適切に選択し、長期的なデータ活用に耐えられる構造を設計することが重要です。

また、データパイプラインの冪等性(同じ処理を何度実行しても同じ結果になる性質)の確保も設計段階から意識すべき重要な要素です。パイプラインが途中で失敗した際に安全に再実行できる設計にしておかないと、本番環境でのトラブル対応が非常に困難になります。さらに、データ依存関係の管理(どのデータがどのデータに依存しているか)を明確化し、Apache Airflowのような依存関係を可視化・管理できるオーケストレーションツールを活用することで、パイプラインの信頼性を高めることができます。

データガバナンスとセキュリティ

データ統合基盤を組織全体で活用するためには、技術的な構築と並行してデータガバナンスの仕組みを整備することが不可欠です。データガバナンスとは、データの定義・品質・アクセス権限・ライフサイクルを組織横断的に管理するための方針・プロセス・組織体制の総称です。具体的には、各データ項目の定義と責任者を定めたデータ辞書の整備、マスターデータ管理(MDM)による顧客コードや商品コードなどの基準データの一元化、データ品質ルール(NULL制約・値域チェック・参照整合性)の定義と自動チェックの実装、そしてデータリネージュ(データの発生から利用までの流れ)の追跡・可視化が主な取り組みとなります。

セキュリティ面では、データウェアハウスへのアクセス権限を役割ベース(RBAC)で細かく制御し、個人情報・機密情報は暗号化(保存時・転送時の両方)した状態で管理することが基本です。特に個人情報を含むデータは、GDPR・個人情報保護法に準拠したデータ取り扱いルールを定め、アクセスログを完全に記録・監査できる体制を整える必要があります。また、データマスキング(テスト環境では本番の個人情報を匿名化して利用)の仕組みを整備し、開発・テスト工程での情報漏洩リスクを低減することも重要です。セキュリティ要件はプロジェクトの初期段階から定義し、アーキテクチャ設計に組み込む「セキュリティ・バイ・デザイン」の考え方が現代のデータ基盤構築の標準となっています。

パートナー選定のポイント

データ統合基盤構築を外部パートナーに依頼する場合、パートナー選定が成否を大きく左右します。選定にあたって最も重視すべきは、類似プロジェクトの実績です。同規模・同業種のデータ統合プロジェクトを手がけた経験があるか、具体的な成果と課題をどのように解決したかを確認することが重要です。技術力の観点では、採用予定のETLツールやデータウェアハウスの認定資格(Snowflake, AWS, GCPなどのパートナー認定)を保有しているか、データエンジニアやデータアーキテクトの専門人材が在籍しているかを確認します。

また、技術力だけでなく、ビジネス側のニーズをデータ基盤の設計に落とし込む「コンサルティング力」も重要な選定基準です。単にシステムを構築するだけでなく、「どのデータを統合することでどのビジネス価値が生まれるか」を一緒に考えてくれるパートナーは、プロジェクトの成果を大きく高めます。さらに、構築後の運用保守・機能拡張フェーズまで継続的に支援できる体制があるか、問題発生時の対応スピードと品質はどうかも重要な確認事項です。複数のベンダーからRFP(提案依頼書)に基づく提案を受け、技術力・費用・サポート体制を多面的に比較したうえで選定することをお勧めします。

まとめ

本記事では、データ統合基盤構築の全体像から具体的な進め方、費用相場、成功のポイントまでを体系的に解説しました。データ統合基盤は、ERP・CRM・SaaS・IoTなど多様なデータソースを一元化し、ビジネスのデータドリブン化を支える重要なシステム基盤です。現状分析・要件定義、アーキテクチャ設計・ツール選定、構築・データ連携・テストという3フェーズを丁寧に踏むことが、プロジェクト成功の基本です。費用は規模によって大きく異なり、小規模で200万〜800万円、大規模では数億円規模のプロジェクトになることも珍しくありません。

データ統合基盤の構築は、技術的な複雑さとビジネス要件の変化への対応が求められる高難度のプロジェクトです。設計フェーズでの拡張性の確保、データガバナンスとセキュリティの組み込み、そして信頼できる外部パートナーとの協働が成功の鍵となります。自社だけで進めることが難しいと感じる場合は、データ統合の専門知識を持つ開発会社にコンサルティングから構築・運用まで一貫して依頼することで、リスクを抑えながら確実に成果を出すことができます。本記事がデータ統合基盤構築プロジェクトの計画・推進に役立てば幸いです。

▼全体ガイドの記事

・データ統合基盤構築の完全ガイド

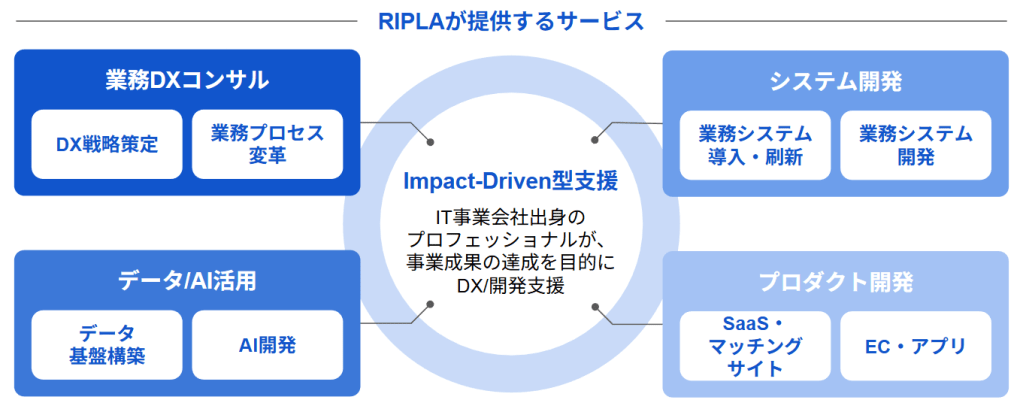

株式会社riplaでは、IT事業会社出身のプロフェッショナルが「Impact-Driven型支援」を通じて、プロダクトやシステムの納品・提供を目的とせず、お客様と同じ目線で、事業成果の達成をゴールとして、高品質なDX/開発支援をいたします。

また、弊社独自の開発テンプレート「Boxシリーズ」による標準機能の高速開発と、AI駆動開発の独自フレームワーク「GoDD」による独自機能のAI実装を組み合わせることで、低コスト・短期間で開発を実現いたします。

もし、システム開発やプロダクト開発に関するご要望がございましたら、お気軽にお問い合わせください。

・サービス概要資料のURLはこちら >>>

・お問合せページのURLはこちら >>>

・お役立ち資料のURLはこちら >>>

株式会社ripla 代表取締役CEOとして、システムパッケージ活用、システム開発、データ分析、生成AI活用、SaaS開発、アプリ開発、EC構築など、幅広い領域で企業のDX推進と事業成長を支援している。IT事業会社出身のプロフェッショナルが集う株式会社riplaにおいて、「Impact-Driven型支援」を掲げ、単なるシステム納品にとどまらず、クライアントと同じ目線で事業成果の実現に向けた伴走支援を行う。早稲田大学卒業後、ラクスル株式会社、LINEヤフー株式会社にて事業開発やDX推進などに従事した後、株式会社riplaを創業。