近年、企業が保有するデータは構造化データにとどまらず、IoTセンサーのログ、SNSの投稿、音声・動画ファイル、PDFドキュメントなど多種多様な形式に広がっています。こうした膨大なデータを一元的に蓄積・管理し、機械学習やBIツールによる分析に活用するための基盤として「データレイク」が注目を集めています。しかし、データレイクの構築は単なるストレージの整備にとどまらず、データパイプライン設計、ガバナンス体制の確立、クラウドサービスの選定など、多岐にわたる意思決定が必要です。実際に構築を進める際には、体系的な進め方を理解したうえで取り組むことが成功の鍵となります。

本記事では、データレイク構築の全体像から具体的な進め方、費用相場、成功のポイントまでを体系的に解説します。データレイク導入を初めて検討している担当者の方はもちろん、既存のデータウェアハウスからの移行や拡張を考えている方にも役立つ内容となっています。各フェーズで押さえるべきポイントを理解することで、プロジェクトを効率よく推進し、データ活用を加速させるための確かな指針を得ることができます。

本テーマに関する全体ガイドは、以下の記事をご覧ください。

▼全体ガイドの記事

・データレイク構築の完全ガイド

データレイク構築の全体像

データレイク構築プロジェクトは、要件定義・データ戦略策定から始まり、設計・環境構築、データ収集・パイプライン構築、テスト・運用開始という大きな流れで進みます。データウェアハウスとの違いや、どのようなデータを対象とするかを明確にしたうえで、クラウドプラットフォームやツール選定を行うことが重要です。ここでは、データレイクの基本的な特徴と選ばれる理由を押さえておきましょう。

データレイクとは何か・特徴

データレイクとは、構造化データ・半構造化データ・非構造化データを問わず、あらゆる形式のデータを原形のまま大規模に蓄積できるストレージ基盤です。リレーショナルデータベースのように事前にスキーマを定義する必要がなく、まずデータを蓄積してから必要に応じてスキーマを適用する「スキーマオンリード」の思想が根底にあります。これにより、ログデータ、画像・動画、センサーデータ、テキストデータなど、将来的にどのような分析に利用するかが未確定の段階でも柔軟にデータを保存することができます。従来のデータウェアハウス(DWH)が事前にデータを整形・構造化してから格納する「スキーマオンライト」であるのに対して、データレイクは生データをそのまま格納することで、後から多様な分析ユースケースに対応できる柔軟性を持ちます。

データレイクが選ばれる理由

データレイクが多くの企業に選ばれる最大の理由は、その拡張性とコスト効率の高さにあります。AWS S3、Azure Data Lake Storage、Google Cloud Storageといったオブジェクトストレージは、ペタバイト規模のデータでも低コストで保存が可能であり、ストレージ容量の上限を気にすることなくデータを蓄積できます。また、機械学習・AIへの活用を見据えたとき、データウェアハウスでは格納が難しい非構造化データ(画像、音声、テキストログなど)もデータレイクであれば問題なく保存・活用できる点が大きな強みです。さらに、Apache SparkやApache Kafkaといった分散処理フレームワークとの親和性が高く、リアルタイムストリーミングからバッチ処理まで幅広いデータパイプラインを構築できることも、データレイクが選ばれる理由のひとつです。DXを推進する企業にとって、将来のデータ活用の可能性を最大限に広げるプラットフォームとしてデータレイクは不可欠な存在になっています。

データレイク構築の進め方

データレイク構築は、大きく「要件定義・データ戦略策定」「設計・環境構築」「データ収集・パイプライン構築・テスト」の3フェーズで進めるのが一般的です。各フェーズで適切な意思決定を行い、フェーズごとに成果物をレビューしながら進めることで、手戻りのリスクを最小化できます。ここでは各フェーズで押さえるべき具体的なポイントを解説します。

要件定義・データ戦略策定フェーズ

データレイク構築の最初のフェーズである要件定義では、「なぜデータレイクが必要か」というビジネス課題の整理から始めます。具体的には、どのようなデータを蓄積するのか(データソースの洗い出し)、誰がどのような目的で利用するのか(ユーザーと利用シナリオの整理)、どのくらいのデータ量・更新頻度が想定されるのかを明確にします。ここで「データで何を達成したいか」というゴールが曖昧なままでは、後工程での手戻りが発生するリスクが高まるため、ビジネスサイドとIT部門が密に連携して要件を固めることが重要です。

データ戦略策定では、クラウドプラットフォームの選定(AWS・Azure・GCPのどれを使うか)、データのゾーニング設計(Raw層・Curated層・Refined層など)、データカタログの方針、アクセス制御ポリシーの大枠を決定します。また、既存のデータウェアハウスやBIツールとの連携方針も検討が必要です。このフェーズは通常4〜8週間を要し、成果物として要件定義書、データソース一覧、データフロー概念図、クラウド選定根拠が作成されます。要件定義の品質が後続フェーズの生産性を大きく左右するため、十分な時間を確保することをお勧めします。

設計・環境構築フェーズ

設計フェーズでは、要件定義で決定した方針をもとに、データレイクの詳細アーキテクチャを設計します。主な設計項目は、ストレージ構造(バケット・ディレクトリ設計)、データフォーマット(Parquet・ORC・Avroなどの選定)、ネットワーク設計(VPC・サブネット・セキュリティグループ)、IAM・アクセス制御設計、暗号化方針、監査ログ設計などです。特にデータのゾーニング設計は重要で、一般的には生データをそのまま保存するBronze層(Raw層)、クレンジング・標準化済みのSilver層(Curated層)、分析用途に最適化されたGold層(Refined層)という3層構造が広く採用されています。

環境構築フェーズでは、設計をもとにクラウド環境の実際の構築作業を行います。IaC(Infrastructure as Code)ツールであるTerraformやAWS CloudFormation、Azure Bicepを活用することで、再現性が高く管理しやすい環境を効率的に構築できます。AWS環境であればS3バケットの作成・設定、IAMロール・ポリシーの定義、AWS Glueのデータカタログ設定、EMRクラスターの構成などが代表的な作業です。Databricksを採用する場合はワークスペースの設定、クラスター構成、Unity Catalogの設定なども必要になります。環境構築フェーズは通常4〜8週間を要し、特に本番・ステージング・開発の各環境を適切に分離して構築することが運用品質の観点から重要です。

データ収集・パイプライン構築・テストフェーズ

パイプライン構築フェーズでは、各データソースからデータレイクへのデータ取り込み処理(インジェスト)を実装します。バッチ処理の場合はAWS Glue、Azure Data Factory、Google Cloud Composerなどのサービスを利用してETL/ELTジョブを作成します。リアルタイム処理が必要な場合はApache KafkaやAWS Kinesis、Azure Event Hubsなどのストリーミングサービスを組み合わせます。各データソースに対してデータ品質チェック(型の整合性、NULL値の確認、重複排除など)を組み込み、不正データが下流に流れないようにする仕組みを設けることが品質維持の観点から不可欠です。

テストフェーズでは、データの整合性テスト、パフォーマンステスト、セキュリティテストなど多角的な検証を行います。特にデータ量が多い環境では、本番相当のデータ量でのパフォーマンス検証を実施することで、本番稼働後の問題を事前に発見できます。また、障害発生時のリカバリー手順(バックアップからの復元、パイプラインの再実行など)を確認しておくことも重要です。テストが完了したら段階的にデータソースを本番接続に切り替え、最終的にすべてのパイプラインが稼働する状態でサービスインを迎えます。テスト・移行フェーズには通常4〜8週間を見込んでおくとよいでしょう。

データレイク構築の費用相場とコスト内訳

データレイク構築の費用は、規模・複雑さ・採用するクラウドサービスやツールによって大きく変動します。小規模なプロジェクトから大規模エンタープライズまで、コストの目安を把握しておくことで、予算計画を現実的に立てることができます。ここでは規模別の費用目安とコスト内訳を解説します。

規模別の費用目安

小規模なデータレイク構築(データエンジニア1〜2人・データソース数本程度)の場合、初期構築費用は100万〜500万円程度が目安です。この規模ではシンプルなS3+Glue構成やAzure Data Lake Storage+Data Factory構成が採用されることが多く、比較的短期間(2〜3ヶ月)での構築が可能です。一方、中規模(複数部門からのデータ収集・10〜20本のパイプライン)では500万〜2,000万円、大規模エンタープライズ(全社横断のデータ統合・100本以上のパイプライン・リアルタイム処理含む)では1,000万〜5,000万円以上の投資が必要になるケースがあります。

これらの費用に加えて、ランニングコスト(クラウドサービス利用料・ライセンス費用・運用保守費用)も考慮が必要です。クラウドの月額利用料は小規模で月5万〜30万円、中規模で月30万〜200万円、大規模では月200万円以上になることもあります。特にDatabricksやSnowflakeなど高機能なプラットフォームを採用する場合は、ライセンス費用が相応に発生するため、初期費用だけでなく3〜5年間のTCO(総保有コスト)で評価することが重要です。また、社内のデータエンジニア育成・教育にかかる費用も見落としがちなコスト要素のひとつです。

インフラ・ツール・開発費の内訳

データレイク構築の費用は、大きく「インフラ費用」「ツール・ライセンス費用」「開発・コンサルティング費用」の3つに分類されます。インフラ費用は、クラウドのオブジェクトストレージ(AWS S3は$0.023/GB/月)、コンピューティング(EMR、Spark クラスターなど)、ネットワーク転送費用などが含まれます。データ量が増加するにつれてインフラ費用も線形に増加するため、ライフサイクルポリシー(アクセス頻度の低いデータをGlacierなど低コストストレージに移動)を設定することでコストを最適化できます。

ツール・ライセンス費用としては、Databricksのワークスペース料金(規模により月数十万〜数百万円)、Apache Airflowのマネージドサービス(MWAA等)、データカタログツール(Collibra、Alation等)のライセンス、BIツール(Tableau、Power BI等)の費用などが挙げられます。開発・コンサルティング費用は、外部ベンダーに依頼する場合の設計・実装・テスト工数であり、データエンジニアのリソース単価は月80万〜150万円程度が市場相場です。プロジェクト全体の費用の50〜70%を開発費が占めるケースが多いため、要件定義の精度を高めて手戻りを防ぐことがコスト管理の観点から重要です。

データレイク構築を成功させるポイント

データレイクプロジェクトの失敗事例の多くは、技術的な問題ではなく、設計段階での方針の曖昧さやデータガバナンスの欠如に起因しています。「データを集めるだけで活用されない」状態、いわゆるデータスワンプ(データ沼)を防ぐためには、設計・ガバナンス・パートナー選定の3つの観点でしっかりと対策を講じることが不可欠です。

設計時の注意点

設計時の最大の注意点は、将来の拡張性を見越したアーキテクチャを選択することです。最初から大規模な環境を構築する必要はありませんが、データ量の増加や新しいデータソースの追加、分析ツールの変更などに柔軟に対応できる設計にしておくことが長期的な運用コストを下げます。たとえば、ストレージとコンピューティングを分離した設計(S3+EMR等)にすることで、処理量に応じてコンピューティングリソースをスケールアウト・スケールインできる柔軟性を確保できます。また、データのパーティション設計(年/月/日/時間などでの分割)は、クエリパフォーマンスとストレージコストの両面に大きく影響するため、利用シナリオを踏まえて慎重に決定する必要があります。

もうひとつの重要な設計ポイントは、データのライフサイクル管理です。すべてのデータを無期限に高コストなストレージに保持することは非効率であり、アクセス頻度や法的保存要件に応じたライフサイクルポリシーを設定することが求められます。具体的には、直近3ヶ月のデータは高速アクセス層、3ヶ月〜2年のデータは低コスト層、それ以上は長期アーカイブ層に自動移行するといったポリシーが一般的です。また、データの削除ポリシーも個人情報保護法・GDPRなどの法令に従って設計し、削除要求への対応フローも事前に整備しておく必要があります。

データ品質とガバナンスのポイント

データレイクがデータスワンプ(データ沼)に陥らないために最も重要なのが、データガバナンスの確立です。データガバナンスとは、どのデータが存在し、誰が管理し、どのような品質基準を満たしているかを組織的に管理する仕組みです。具体的には、データカタログの整備(どのデータがどこに存在するかのメタデータ管理)、データオーナーシップの明確化(各データの責任部門・責任者の特定)、データ品質ルールの設定(完全性・正確性・一貫性の基準)、アクセス制御ポリシーの運用(誰がどのデータにアクセスできるかの管理)が4つの柱となります。

データ品質管理の実装としては、Great Expectations、dbt(data build tool)、AWS Deequ、Apache Griffinなどのツールがよく利用されます。パイプラインの各ステージでデータ品質チェックを自動実行し、品質基準を満たさないデータは隔離・通知する仕組みを組み込むことで、下流の分析・機械学習に悪影響を及ぼすデータ品質問題を未然に防げます。また、データリネージ(データの発生源から加工・利用までの流れを追跡できる機能)を整備することで、問題発生時の原因調査や影響範囲の特定が容易になります。Apache Atlas、OpenLineage、DataHubなどのデータリネージツールの導入も検討に値します。

パートナー選定のポイント

データレイク構築を外部パートナーに依頼する場合、技術力と業務理解力の両方を持つパートナーを選ぶことが成功の鍵です。技術面では、採用予定のクラウドプラットフォーム(AWS・Azure・GCP)の認定資格を持つエンジニアが在籍しているか、Apache SparkやKafka、Databricks等の主要ツールの実装経験があるか、データエンジニアリングとデータガバナンスの両方のノウハウを持っているかを確認することが重要です。また、単なるシステム構築だけでなく、データ活用の観点からコンサルティングできるパートナーであれば、より高い価値を提供してもらえます。

パートナー選定では、過去の類似プロジェクトの実績と事例を必ず確認しましょう。業界・業種が近い企業でのデータレイク構築経験があるパートナーは、業界特有の要件やデータ特性を理解したうえで提案してくれるため、プロジェクトの品質が高まります。また、構築後の運用保守やデータエンジニアリングの内製化支援まで対応できるパートナーを選ぶことで、長期的な関係を構築しやすくなります。費用面では、固定価格での請負と時間単価でのコンサルティングを組み合わせた柔軟な契約形態を提案できるパートナーが理想的です。

まとめ

データレイク構築は、企業のデータ活用基盤を整備するうえで非常に重要な取り組みです。構造化・非構造化を問わず大量のデータを低コストで蓄積し、機械学習・BI・リアルタイム分析に活用できる環境を整えることで、DX推進の加速や競争力の強化につながります。成功のためには、要件定義の精度を高め、データガバナンスを早期に確立し、適切なパートナーと連携することが欠かせません。

本記事で解説した進め方・費用・成功ポイントを参考に、自社のデータレイク構築プロジェクトを計画的に推進してください。初めての取り組みで不安がある場合は、まず小規模なPoCから始め、段階的にスケールアップするアプローチも有効です。データレイクの構築から運用まで一気通貫でサポートできるパートナーを探している場合は、ぜひriplにご相談ください。

▼全体ガイドの記事

・データレイク構築の完全ガイド

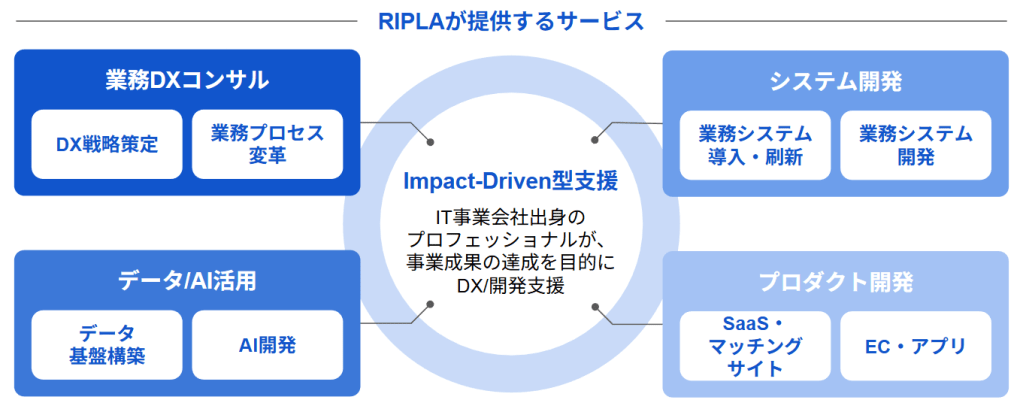

株式会社riplaでは、IT事業会社出身のプロフェッショナルが「Impact-Driven型支援」を通じて、プロダクトやシステムの納品・提供を目的とせず、お客様と同じ目線で、事業成果の達成をゴールとして、高品質なDX/開発支援をいたします。

また、弊社独自の開発テンプレート「Boxシリーズ」による標準機能の高速開発と、AI駆動開発の独自フレームワーク「GoDD」による独自機能のAI実装を組み合わせることで、低コスト・短期間で開発を実現いたします。

もし、システム開発やプロダクト開発に関するご要望がございましたら、お気軽にお問い合わせください。

・サービス概要資料のURLはこちら >>>

・お問合せページのURLはこちら >>>

・お役立ち資料のURLはこちら >>>

株式会社ripla 代表取締役CEOとして、システムパッケージ活用、システム開発、データ分析、生成AI活用、SaaS開発、アプリ開発、EC構築など、幅広い領域で企業のDX推進と事業成長を支援している。IT事業会社出身のプロフェッショナルが集う株式会社riplaにおいて、「Impact-Driven型支援」を掲げ、単なるシステム納品にとどまらず、クライアントと同じ目線で事業成果の実現に向けた伴走支援を行う。早稲田大学卒業後、ラクスル株式会社、LINEヤフー株式会社にて事業開発やDX推進などに従事した後、株式会社riplaを創業。