「データ分析を導入したいが、何から始めればよいかわからない」「データはたくさんあるのに、うまく活用できていない」——こうした課題を抱えるIT担当者や経営幹部は数多くいます。データ分析・活用は、経営判断の精度を上げ、業務効率化やビジネス成長を実現する強力な手段ですが、目的の設定からデータ収集・前処理・分析・可視化・活用サイクルを正しく回すには、体系的な進め方が不可欠です。

本記事では、データ分析・活用の進め方を各フェーズごとに詳しく解説します。初めてデータ分析に取り組む方から、過去に失敗経験を持つ方まで、幅広くお役立ていただける内容となっています。データ分析環境の構築費用や外注時のポイント、ツール選定・人材・組織体制についても解説しますので、ぜひ参考にしてください。

本テーマに関する全体ガイドは、以下の記事をご覧ください。

▼全体ガイドの記事

・データ分析/活用の完全ガイド

データ分析・活用とは何か、なぜ重要か

データ分析・活用とは、企業が保有するさまざまなデータを収集・整理・分析することで、ビジネス上の意思決定や業務改善に役立てる取り組みを指します。売上データ・顧客データ・行動ログ・市場データなどを統合的に分析し、「何が起きているか(記述分析)」「なぜ起きているか(診断分析)」「これから何が起きるか(予測分析)」「どうすればよいか(処方分析)」という4つの視点からインサイトを引き出すことがデータ活用の本質です。

データ分析・活用の定義と種類

データ分析は、その目的や手法によっていくつかの種類に分類されます。まず「記述分析(Descriptive Analytics)」は、過去のデータを集計・可視化して現状を把握するための分析です。月別売上推移・顧客属性分布・商品別利益率など、BIダッシュボードで日常的に活用されている分析がこれにあたります。次に「診断分析(Diagnostic Analytics)」は、ある現象がなぜ起きたかの原因を掘り下げる分析です。売上が前月比で落ちた場合に、どのセグメント・商品・チャネルが影響しているかをドリルダウンで分析します。

「予測分析(Predictive Analytics)」は、過去のデータのパターンを機械学習モデルで学習し、将来の需要・チャーンリスク・不正検知などを予測します。「処方分析(Prescriptive Analytics)」は、予測をもとに最適なアクション(価格設定・在庫補充量・マーケティング施策など)を推奨します。近年では生成AIを活用した自然言語での分析クエリや、AutoMLを使った予測モデル構築の自動化も急速に普及しており、データ分析の民主化が進んでいます。企業が取り組むべきデータ分析の種類は、ビジネス上の課題と優先度に応じて選択することが重要です。

データ分析・活用が重要な理由

データ分析・活用が重要な理由は、ビジネス環境の変化速度の加速にあります。市場・顧客・競合の変化をリアルタイムで把握し、データに基づく迅速な意思決定を行う「データドリブン経営」が、競争優位性の確立に直結するようになっています。感覚や経験則だけに頼った意思決定では、機会損失やリソースの無駄遣いが生じやすく、特に市場規模が大きく競争が激しい業種では致命的なハンデとなります。

また、生成AI・機械学習の急速な普及により、大量のデータを高品質に整備することが、AIプロジェクトの成否を分ける最重要要素となっています。データの収集・整備に取り組んでいる企業と、そうでない企業との間でAI活用の差は今後ますます広がることが予想されます。さらに、顧客体験のパーソナライゼーションや需要予測による在庫最適化、不正取引検知、製造ラインの予知保全など、具体的な業務価値に直結する活用場面も急増しています。データ分析・活用への投資は、単なるIT投資ではなく、経営戦略の中核をなす取り組みとして位置づけることが必要です。

データ分析・活用の進め方:各フェーズの詳細

データ分析・活用プロジェクトは、①目的設定、②データ収集、③データ前処理、④分析・モデリング、⑤可視化・レポーティング、⑥業務活用・改善のPDCAという6つのフェーズで進めるのが基本です。各フェーズを順番に丁寧に踏むことで、分析の精度と業務への貢献度が大きく高まります。

フェーズ1:目的設定と課題の明確化

データ分析プロジェクトが失敗する最大の原因の一つは、「なんとなくデータを集めて分析してみる」という目的設定の曖昧さです。最初に「分析によって解決したいビジネス課題は何か」「分析結果をどの意思決定に活かすか」「成功の判断基準(KPI)は何か」を明確にすることが、プロジェクト全体の成否を左右します。例えば「顧客解約率を半年で5%削減する」「在庫欠品率を10%改善する」「マーケティング費用対効果を20%向上させる」といった、測定可能で具体的なゴール設定が重要です。

目的設定の段階では、ビジネス部門(課題オーナー)とデータ部門(分析担当者)が共同でワークショップを実施し、課題の優先順位付けと分析スコープの合意を形成することが推奨されます。この段階で「そのデータは本当に存在するか」「どの程度の期間・コストで分析できるか」の概算的な実現可能性も確認しておくと、後工程でのスコープ修正を最小化できます。また、一つの大きな分析プロジェクトとして取り組むより、スモールスタート(小さなPoC:概念実証)から始めて成果を示しながら段階的に拡張する方が、組織の合意形成と継続的な支援を得やすい傾向があります。

フェーズ2:データ収集と環境構築

目的が定まったら、分析に必要なデータの収集と分析環境の構築を行います。データ収集では、社内システム(ERP・CRM・SFA・ECサイト等)からのデータ抽出、外部データ(市場調査・気象データ・SNSデータ等)の収集、IoTセンサーや実験データの収集など、分析目的に応じた適切なデータソースを特定します。この段階でデータのサンプルを取得し、「分析に必要なデータが実際に存在するか」「データの品質(NULL率・重複・フォーマットの一貫性)は十分か」を早期に確認することが重要です。

分析環境の構築では、データの規模・分析の目的・チームのスキルに合わせて適切なツールを選定します。小規模な分析(数万行以下)であればExcel・Google Sheetsでも対応可能ですが、大規模データや継続的な分析には、Snowflake・BigQuery・Redshiftなどのクラウドデータウェアハウスと、TableauやLooker・Power BIなどのBIツールの組み合わせが効果的です。Pythonデータ分析(pandas・scikit-learn・PyTorch等)が必要な高度な機械学習プロジェクトには、AWS SageMaker・Google Vertex AI・Azure Machine LearningといったマネージドML基盤の活用も検討します。データパイプラインの自動化にはdbt(データ変換)やApache Airflow(オーケストレーション)が広く採用されています。

フェーズ3:データ前処理・クレンジング

データ分析プロジェクトの工数の大半(一般的に全工数の50〜80%)を占めると言われるのが、データの前処理・クレンジングフェーズです。生データには、欠損値(NULL)・外れ値・重複レコード・フォーマットの不統一(日付形式の差異・単位の不一致)・表記ゆれ(「株式会社○○」と「(株)○○」など)といった品質問題が必ずと言っていいほど存在します。これらを適切に処理しないと、分析結果の信頼性が損なわれ、誤った意思決定につながるリスクがあります。

前処理の主な作業内容としては、①欠損値の処理(削除・平均値補完・高度な補間モデルによる推定)、②外れ値の検出と処理(統計的手法:IQR法・Z-score法・ドメイン知識に基づく判断)、③重複レコードの削除(主キーの設定と一意性の確保)、④データ型の統一と変換(文字列→数値、日付フォーマットの統一)、⑤テーブル間のJOIN・データ統合(複数ソースのデータをキーで結合)、⑥特徴量エンジニアリング(機械学習モデルのための変数加工)が挙げられます。データの前処理は一度やれば終わりではなく、新たなデータが追加されるたびに継続的に実施する必要があるため、前処理パイプラインの自動化(dbt・PythonスクリプトのAirflow化等)を早い段階から意識することが重要です。

フェーズ4:分析・モデリング

データの準備が整ったら、いよいよ分析・モデリングフェーズです。記述分析では、SQLによる集計クエリやPythonのpandasライブラリを使い、平均・中央値・標準偏差・百分位数などの基本統計量の算出、クロス集計、時系列トレンドの分析などを行います。診断分析では、分散分析(ANOVA)・相関分析・コホート分析などを活用して、現象の原因を掘り下げます。

予測分析では、機械学習モデルを活用します。需要予測・価格最適化には時系列分析(Prophet・SARIMA・LightGBM等)、顧客チャーン予測・信用スコアリングには分類モデル(ロジスティック回帰・ランダムフォレスト・XGBoost等)、レコメンデーションには協調フィルタリングや深層学習モデルを採用するケースが多いです。モデルの性能評価では、学習データのみならずホールドアウトデータ(未知データ)での検証精度(AUC・RMSE・精度・再現率等)を確認し、過学習がないかを検証することが重要です。また、モデルの解釈可能性(SHAP値などによる特徴量の寄与度分析)も、ビジネス担当者への説明責任の観点から重視すべきポイントです。

フェーズ5:可視化・レポーティング

分析結果を経営層や業務担当者に伝え、意思決定に活かすためには、適切な可視化・レポーティングが不可欠です。分析者が「面白い結果が出た」と思っても、ビジネス担当者に伝わらなければ意味がありません。可視化の基本原則は、「伝えたいメッセージを一つに絞る」「比較・変化・割合・分布の4つの目的に合ったグラフタイプを選ぶ」「色・サイズ・軸の設定で誤解を生まない設計にする」ことです。

継続的なモニタリングには、BIダッシュボードの整備が有効です。Tableau・Looker・Power BI・Google Looker Studioなどのツールを使い、KPIの推移・アラート・ドリルダウン分析を組み込んだインタラクティブなダッシュボードを構築することで、経営層・事業部門が日常的にデータを活用する文化を醸成できます。ダッシュボードの設計では、ユーザーが「何を知りたいか」「どの粒度で見たいか」を事前にヒアリングし、使い勝手の良いUIを設計することが重要です。分析レポートの定期配信(週次・月次)も、データ活用の習慣化を促す有効な手段です。

フェーズ6:業務活用・改善のPDCA

データ分析の最終的な価値は、分析結果を実際のビジネスアクションに結びつけることで初めて生まれます。分析結果から得られたインサイトをもとに施策を実施し(Plan・Do)、その効果をデータで検証し(Check)、次の分析・改善につなげる(Act)というPDCAサイクルを継続的に回すことが、データ活用を組織に定着させる鍵です。分析結果がアクションにつながらない場合は、「ビジネス担当者との連携不足」「分析結果の伝え方の問題」「組織の意思決定プロセスへの組み込みの不足」のいずれかが原因である場合が多いです。

A/Bテスト(ランダム化比較試験)は、施策の因果効果を測定する最も信頼性の高い手法であり、マーケティング施策・UI改善・価格変更などの検証に積極的に活用することを推奨します。また、機械学習モデルは時間の経過とともにパフォーマンスが劣化する「モデルドリフト」の問題が発生するため、定期的な再学習とモデルパフォーマンスのモニタリングを組み込んだ運用体制を整備することが重要です。データ活用の成功事例を社内で積極的に発信し、他部門への横展開を促すことで、データドリブン文化の組織的な定着を図ることができます。

データ分析環境構築・外注費用の目安

データ分析・活用に取り組む際の費用は、分析の規模・目的・外注の有無によって大きく異なります。自社内で分析担当者が手元ツールで行う小規模な分析から、クラウドDWH+BIツール+機械学習基盤を組み合わせた本格的な分析基盤の構築まで、費用のレンジは幅広いです。

分析ツール・環境費用の目安

分析環境の費用は、採用するツールによって大きく異なります。BIツールのライセンス費用は、Tableau(Tableau Creator:約10万円/ユーザー/年〜)、Power BI(Microsoft 365に含まれる場合あり、Power BI Pro:約1,500円/ユーザー/月)、Looker(Google Cloudのサービスで数十万円/月〜)、Google Looker Studio(無償)と幅広い価格帯があります。クラウドデータウェアハウスのコストは、Snowflakeがコンピューティング($2〜$4/クレジット)+ストレージ($23/TB/月)、BigQueryがクエリ処理量($5/TB)+ストレージ($0.02/GB/月)が基本で、中規模の利用であれば月額数万円〜数十万円が目安です。

機械学習基盤のコストは、AWS SageMaker・Google Vertex AI・Azure Machine Learningなどのマネージドサービスを使う場合、利用するインスタンスタイプと時間に応じた従量課金となり、開発フェーズで月数万円〜、本番運用時に月数十万円〜が目安です。データパイプラインツールのコストは、Fivetran(SaaSコネクタ:月額数万円〜)やAirbyteのクラウド版(月額数万円〜)、dbt Cloud(月額数万円〜)などが代表的です。オープンソースのdbt Core・Apache Airflowを自社でホストする場合はライセンスコスト不要ですが、インフラ費用と運用工数がかかります。

外注費用の規模別目安

データ分析・活用を外部のデータ分析会社・コンサルティングファームに委託する場合の費用目安は以下の通りです。データ分析のPoC(概念実証)フェーズ(特定のビジネス課題に対する分析モデルの試作・検証)は、分析コンサルタント1〜2名で1〜3ヶ月のプロジェクトとなることが多く、100万〜500万円程度が目安です。BIダッシュボードの設計・構築(KPIダッシュボードの要件定義〜Tableau/Power BI上への実装まで)は、200万〜800万円程度。データ基盤(DWH)の構築を含む本格的なデータ分析基盤の導入プロジェクトは、500万〜3,000万円程度が一般的な目安となります。

機械学習モデルの開発・本番実装(需要予測・チャーン予測・レコメンデーション等)は、モデルの複雑さとデータ準備の工数によって大きく異なりますが、300万〜2,000万円程度が一般的です。データ分析コンサルタントの人月単価は、ジュニア(〜3年程度)で60万〜80万円/月、シニア(5年以上)で100万〜200万円/月が相場です。費用対効果の観点から、外注費用とそれによって期待されるビジネス価値(売上向上・コスト削減・リスク低減等)を定量的に試算したうえで、外注範囲を決定することを推奨します。

データ分析・活用を成功させるポイント

データ分析・活用プロジェクトの成否は、技術的な要素だけでなく、ツール選定・人材育成・組織体制の整備といった非技術的な要因に大きく左右されます。ここでは、プロジェクトを成功に導くための3つの重要ポイントを解説します。

ツール選定の考え方

データ分析ツールの選定では、「現時点での自社の課題解決に必要な機能を持つか」「チームのスキルセットに合っているか」「将来の拡張性があるか」「費用対効果は適切か」の4点を評価軸にすることを推奨します。高機能・高価格のツールを導入しても、使いこなせなければ意味がありません。まず手軽に始められるツール(Google Looker Studio・Power BI等)でデータ活用の文化を育て、ニーズが高まるにつれてより高機能なツールに移行するアプローチが現実的です。

特定のクラウドベンダー(AWS・GCP・Azure)のサービスで統一するか、マルチクラウドで最適なツールを組み合わせるかも重要な判断事項です。ベンダーロックインのリスクを避けるためにマルチクラウドを採用するケースも多いですが、連携の複雑さが増すため、特に初期段階では単一クラウドで統一する方がシンプルで管理しやすいケースが多いです。オープンソースツール(dbt・Apache Airflow・Metabase等)の活用はコスト削減に有効ですが、社内での運用管理スキルが必要であることも考慮が必要です。ツール選定は一度決めると変更コストが高いため、トライアル利用・PoC・社内レビューを経て慎重に決定することが重要です。

人材育成とスキルセット

データ分析・活用に必要な人材は、「データエンジニア(データ基盤の構築・パイプライン開発)」「データアナリスト(BIダッシュボード・集計分析・レポーティング)」「データサイエンティスト(機械学習モデルの開発・評価)」「ビジネスアナリスト(ビジネス課題の定義・分析結果の解釈・業務への橋渡し)」の4つの役割に整理されます。全ての役割を一人でこなす「フルスタックデータ人材」の採用は難しいため、チームで補完し合う体制が現実的です。

社内人材の育成では、まずSQL・Excelの基礎スキルを全社員に普及させることで「データリテラシー」を高めることが重要です。中級者向けにはPythonデータ分析(pandas・matplotlib)・BIツール操作の研修を提供し、上級者向けには機械学習・統計解析の専門研修やデータエンジニアリングのコースを用意するステップアップ型の育成プログラムが有効です。採用面では、データエンジニア・データサイエンティストの市場需給が逼迫しているため、未経験者の採用・育成と経験者採用を組み合わせるアプローチが現実的です。外部コンサルタントやフリーランスのデータ専門家の活用も、スピーディーな立ち上げと社内人材の育成を両立する有効な手段です。

組織体制とデータガバナンス

データ分析・活用を組織として推進するための体制として、「集中型(CoE:Center of Excellence)」「分散型」「ハイブリッド型」の3つのモデルがあります。集中型は、データ専門チームを中央に置き、各事業部門の分析ニーズに対応する形態で、専門性を集中させやすい反面、ニーズへの対応が遅くなるリスクがあります。分散型は各事業部門にデータ担当者を置く形態で、ビジネスに近い位置での意思決定が可能ですが、データの一貫性やガバナンスが難しくなります。

多くの企業では、中央にデータ基盤・データガバナンスを担うデータエンジニアリングチームを置きつつ、各事業部門にデータアナリストを配置する「ハイブリッド型」が最適とされています。データガバナンスの観点では、データオーナーシップの定義(誰がどのデータに責任を持つか)、データカタログの整備(どこにどのデータがあるかの一元管理)、データ品質基準の設定と定期チェック、アクセス権限管理(ロールベースのアクセスコントロール)が不可欠です。データガバナンスが整備されていない組織では、データの信頼性が低くなり、分析結果への懐疑論が広がって、データ活用文化の定着が阻害されます。データガバナンスの整備は地味な作業ですが、データ活用を組織的に成功させるための根幹となる重要な取り組みです。

まとめ

本記事では、データ分析・活用の進め方について、①目的設定、②データ収集・環境構築、③データ前処理、④分析・モデリング、⑤可視化・レポーティング、⑥業務活用・改善のPDCAという6つのフェーズで体系的に解説しました。各フェーズを丁寧に踏むことで、データ分析の精度と業務貢献度が大幅に向上します。費用面では、ツール・環境費用(月数万円〜数十万円)と外注費用(PoC:100万〜500万円、本格基盤構築:500万〜3,000万円)を参考にしてください。

成功のポイントは、「明確な目的設定」「適切なツール選定」「人材育成とデータリテラシーの向上」「データガバナンスの整備」の4点に集約されます。最初から完璧な基盤を目指すのではなく、スモールスタートで成果を出しながら段階的に拡張するアプローチが、多くの企業でデータ活用を成功させる王道です。本記事がデータ分析・活用の取り組みを進める際のご参考となれば幸いです。

▼全体ガイドの記事

・データ分析/活用の完全ガイド

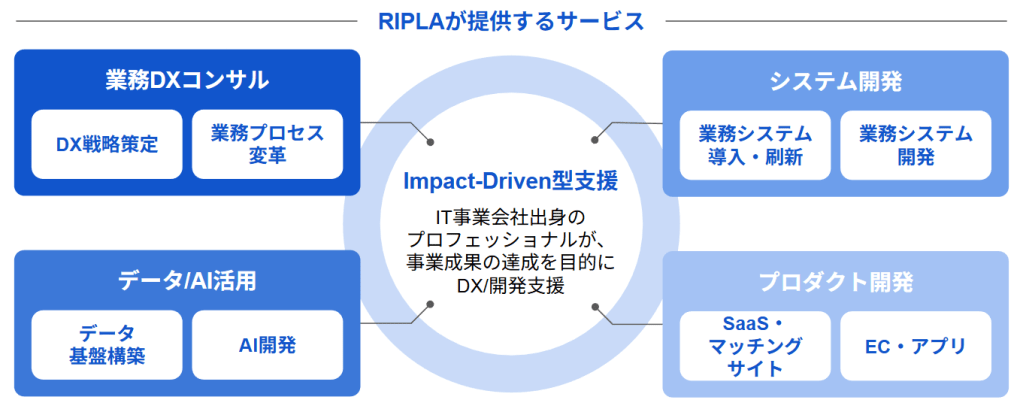

株式会社riplaでは、IT事業会社出身のプロフェッショナルが「Impact-Driven型支援」を通じて、プロダクトやシステムの納品・提供を目的とせず、お客様と同じ目線で、事業成果の達成をゴールとして、高品質なDX/開発支援をいたします。

また「Boxシリーズ」による、受発注管理・在庫管理・配送管理・業務システム・生成AI・SaaS・マッチングサイト・EC・アプリ・LINEミニアプリなどの標準機能の高速開発と、AI駆動開発の独自フレームワーク「GoDD」を活用することで、低コスト・短期間でのスクラッチ開発を実現いたします。

もし、システム開発やプロダクト開発に関するご要望がございましたら、お気軽にお問い合わせください。

・サービス概要資料のURLはこちら >>>

・お問合せページのURLはこちら >>>

・お役立ち資料のURLはこちら >>>

株式会社ripla 代表取締役CEOとして、システムパッケージ活用、システム開発、データ分析、生成AI活用、SaaS開発、アプリ開発、EC構築など、幅広い領域で企業のDX推進と事業成長を支援している。IT事業会社出身のプロフェッショナルが集う株式会社riplaにおいて、「Impact-Driven型支援」を掲げ、単なるシステム納品にとどまらず、クライアントと同じ目線で事業成果の実現に向けた伴走支援を行う。早稲田大学卒業後、ラクスル株式会社、LINEヤフー株式会社にて事業開発やDX推進などに従事した後、株式会社riplaを創業。